Langdock Grundkurs: Enterprise-AI sicher nutzen

Vom ersten Chat bis zum sicheren Workflow: Langdock praxisnah für Teams, Fachbereiche und IT einführen

Von Intent-Design bis RAG: Chatbots, die Prozesse entlasten und Antworten liefern, die Nutzer akzeptieren.

Alle Kurse anzeigenVom ersten Chat bis zum sicheren Workflow: Langdock praxisnah für Teams, Fachbereiche und IT einführen

5 tägiges Intensivtraining zur Automatisierung von Workflows und Aufgaben mit selbstlernenden KI-Agenten

Praxisnahes Training für RAG-Pipelines, semantische Suche und produktive Enterprise AI

Von Use Case bis Betrieb: Support-Automation aufbauen, messen und sicher steuern, ohne dich in Tool-Details zu verlieren.

Im digitalen Zeitalter erwarten Kunden schnelle, präzise und personalisierte Antworten. Dialogflow, ein KI-gestütztes Tool von Google, ermöglicht die Entwicklung moderner Chatbots, die genau diesen..

Wir bieten die Kurse auch als Inhouse oder Firmenseminar an - vor Ort oder Live-Online.

In diesem Kurs lernen Sie, wie Chatbots und virtuelle Assistenten den Kundenservice automatisieren und verbessern . Sie erfahren, welche Technologien und Plattformen verfügbar sind, wie Sie leistungsfähige..

Baue Chatbot-Funnels, die qualifizieren, statt nur zu antworten und miss dabei sauber den Beitrag zu Pipeline und Umsatz.

In der heutigen digitalisierten Welt spielen Chatbots und künstliche Intelligenz (KI) eine immer größere Rolle. Das Seminar "Chatbots und Datenschutz" beleuchtet sowohl die Chancen als auch die Risiken des..

Wir erstellen dir gern ein individuelles Trainingsangebot.

Keine Schulungen gefunden

Bitte passe deine Filter an.

Diese Kurs-Kategorie richtet sich an alle, die Chatbots nicht nur „zum Laufen bringen“, sondern produktiv betreiben und kontinuierlich verbessern wollen. Im Fokus stehen praxisnahe Methoden für Chatbot-Entwicklung und Anpassung: Anforderungsanalyse, Use-Case-Schnitt, KPI-Definition und ein Setup, das in Support, HR, IT-Service oder Vertrieb wirklich entlastet.

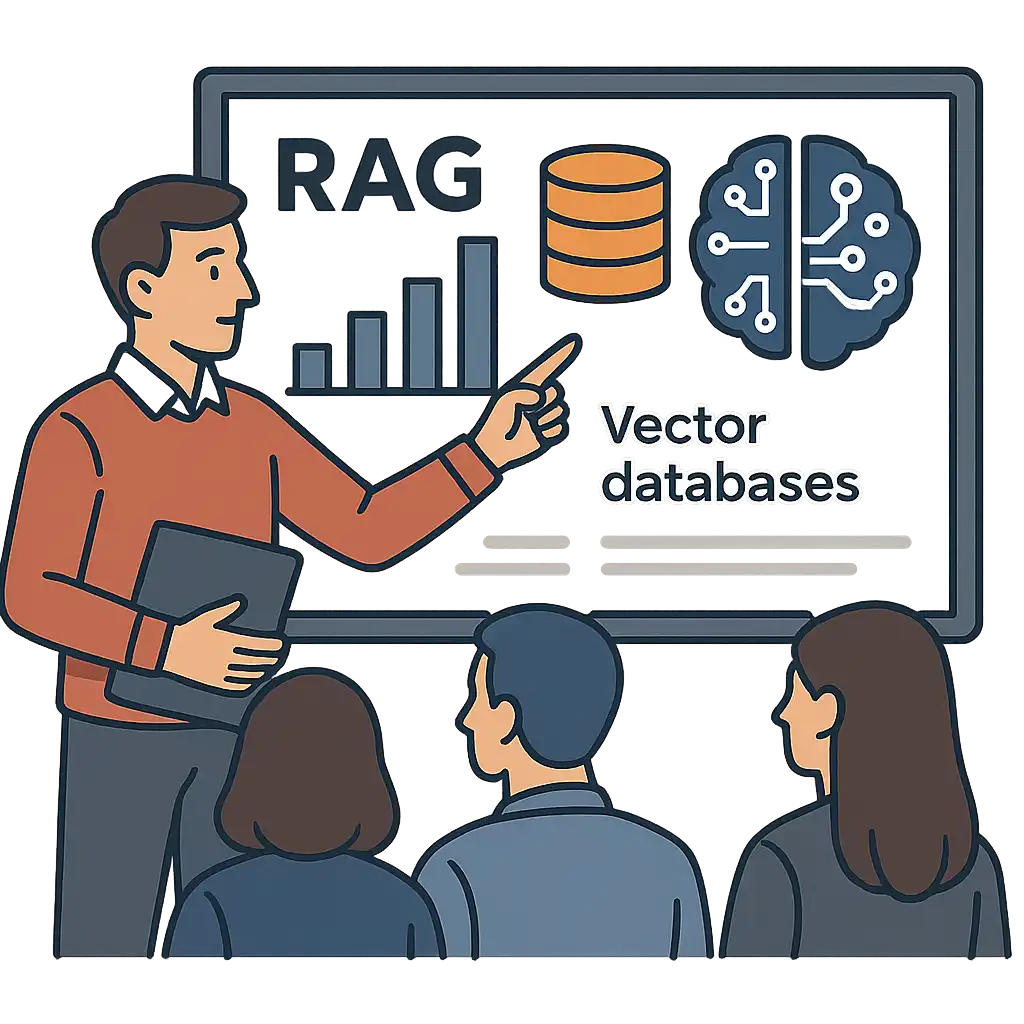

Sie arbeiten an Conversation Design und Dialoglogik (Intents, Entities, Slots, Kontext), an Tonalität und Wissensstruktur sowie an robusten Fallback- und Eskalationspfaden. Ein Schwerpunkt liegt auf LLM-basierten Chatbots: Prompt-Engineering für wiederholbare Ergebnisse, Retrieval-Augmented Generation (RAG) mit Vektordatenbanken, Quellenzitierung, Evaluations-Setups und Guardrails gegen Halluzinationen und Policy-Verstöße.

Ergänzend behandeln die Kurse Integrationen und Betrieb: Anbindung an CRM/ITSM, APIs und Webhooks, Authentifizierung, Logging, Monitoring, A/B-Tests, Datenschutz (DSGVO) und sichere Datenflüsse. Ziel ist, dass Sie Chatbots so bauen, dass sie skalieren, auditierbar sind und sich anhand von Nutzersignalen messbar weiterentwickeln.

Weitere häufig gestellte Fragen und Antworten findest du in den FAQs .

Wer nach „Chatbot Entwicklung“, „Chatbot anpassen“ oder „LLM Chatbot bauen“ sucht, meint selten ein Demo-Projekt. In der Praxis zählen stabile Antworten, geringe Bearbeitungszeiten und ein Bot, der sich in bestehende Systeme einfügt. Genau darauf zielen Weiterbildungen in dieser Kategorie: Sie lernen, Chatbots entlang echter Geschäftsprozesse zu konzipieren, umzusetzen und zu optimieren.

Ein zentraler Baustein ist Conversation Design. Statt zufälliger Dialoge entwickeln Sie Intent-Modelle, Entitäten, Kontextführung und klare Fallback-Strategien. Damit steigt die Lösungsquote und sinkt die Frustration bei Nutzern. Für LLM-basierte Chatbots kommen zusätzliche Anforderungen hinzu: Prompt-Engineering für konsistente Ausgaben, Rollen- und Richtliniensteuerung, strukturierte Antworten (z.B. JSON), sowie Evaluationsmethoden, um Qualität reproduzierbar zu messen.

Besonders gefragt ist Retrieval-Augmented Generation (RAG). Sie verbinden ein LLM mit Unternehmenswissen, etwa aus Confluence, SharePoint, PDFs oder Ticket-Systemen. Kurse zeigen, wie Chunking, Embeddings, Vektordatenbanken, Re-Ranking und Quellenzitierung zusammenspielen, damit Antworten nachvollziehbar bleiben. Ebenso wichtig sind Guardrails, Red-Teaming und Sicherheitsmaßnahmen, um Datenabfluss, Prompt Injection und Halluzinationen zu reduzieren.

Für den produktiven Einsatz gehören Integrationen (APIs, Webhooks, CRM/ITSM), Monitoring, Logging, Analytics und A/B-Tests dazu. Sie lernen, wie man Chatbots anhand von Gesprächsdaten iterativ verbessert, ohne Datenschutz und DSGVO zu verletzen. So entsteht ein Chatbot, der nicht nur „antwortet“, sondern messbar Arbeit abnimmt und zuverlässig skaliert.